전자전기공학부 문태섭 교수 연구팀,

적응형 평생학습 알고리즘 개발 및

설명가능 인공지능 방법의 취약성 규명

- 세계 최고 AI/기계학습 학술대회인 신경정보처리학회에 논문 2편 발표

[좌측부터] 문태섭 교수, 안홍준 공동 제1저자, 차성민 공동 제1저자, 허주연 공동 제1저자, 주성환 공동 제1저자

[좌측부터] 문태섭 교수, 안홍준 공동 제1저자, 차성민 공동 제1저자, 허주연 공동 제1저자, 주성환 공동 제1저자

전자전기공학부 문태섭 교수 연구팀은 인공지능 분야의 두 가지 핵심기술[적응형 평생학습 알고리즘 개발(공동 1저자 안홍준 석사과정, 차성민 박사과정) 및 설명가능 인공지능 방법의 취약성 규명(공동 제 1저자 허주연 석사과정, 주성환 석박통합과정)] 개발에 성공했다고 밝혔다.

본 연구는 과학기술정보통신부(MSIT)의 재원으로 정보통신기획평가원(IITP)과 한국과학기술연구원(KIST)의 지원을 받아 수행되었으며, 12월 9일(월) AI/기계학습 분야의 세계 최고 권위의 학술대회인 신경정보처리학회(Neural Information Processing Systems, NeurIPS)에서 논문 2편을 발표하였다.

NeurIPS 학술대회는 매년 매우 치열한 경쟁과 엄격한 리뷰과정을 통해 논문들을 채택하는데(채택률 21.1%) 올해 국내에서 2편 이상 논문이 채택된 단일 연구실은 문태섭 교수 연구실이 유일했다.

[논문1] Hongjoon Ahn*, Sungmin Cha*, Donggyu Lee, and Taesup Moon, “Uncertainty-based Continual Learning with Adaptive Regularization” (*equal contribution)[논문2] Juyeon Heo*, Sunghwan Joo*, and Taesup Moon, “Fooling Neural Network Interpretations via Adversarial Model Manipulation”(*equal contribution)

연구팀이 첫 번째로 개발한 적응형 평생학습 알고리즘은 기계학습 분야의 오랜 난제 중 하나인, 순차적인 과제들을 계속해서 효율적으로 학습할 수 있는 연속 학습(Continual learning) 문제를 다루고 있다. 본 연구에서는 베이지안 온라인 학습(Bayesian online learning)에 기반하여 뉴럴 네트워크 모델 파라미터의 불확실성에 대한 정의를 새롭게 제시함으로써 기존의 방법에 비해 약 30% 이상 적은 메모리를 사용하면서도, 적응적으로 새로운 개념을 익히고 과거의 지식을 점진적으로 망각해 갈 수 있는 알고리즘을 고안하였다. 그 결과, 다양한 지도학습과 강화학습 상황에서 공히 기존 알고리즘들을 압도하는 성능을 선보였다.

두 번째 연구인 설명가능 인공지능 방법의 취약성 규명은 최근 딥러닝 알고리즘의 예측 결과를 설명하는데 많이 사용되는 특징 지도(saliency-map) 기반의 딥러닝 해석 방법(interpretation method)이 적대적인 모델 조작(adversarial model manipulation)에 매우 취약할 수 있다는 것을 제시했다. 특징 지도 기반의 딥러닝 해석 방법들은 특히 딥러닝 모델의 편향성 등을 탐지하는 데 중요하게 쓰일 수 있다고 알려져 있는데, 본 연구에서 제안한 적대적 모델 조작을 가하게 되면 예측 정확도는 거의 변하지 않는 상태에서 전혀 판이한 해석 결과가 나올 수 있음을 제시했다.

문태섭 교수는 “적응형 평생학습 알고리즘은 실제 AI기술을 사용하는 응용 분야에서 매우 필요로 하는 실용적인 기술이고, 향후 이 기술을 더 발전시킨다면 데이터가 순차적으로 확보될 수밖에 없는 응용 분야에 널리 쓰일 수 있는 높은 파급력을 가졌다”고 말했다. 또한, “설명가능 인공지능 기술의 취약성을 보인 연구는 향후 더욱 모델과 데이터에 가해지는 적대적인 공격에 더욱 강건한 설명가능 인공지능 기술을 개발하는 데 필수적으로 고려해야 하는 기준을 제시했다”고 설명했다.

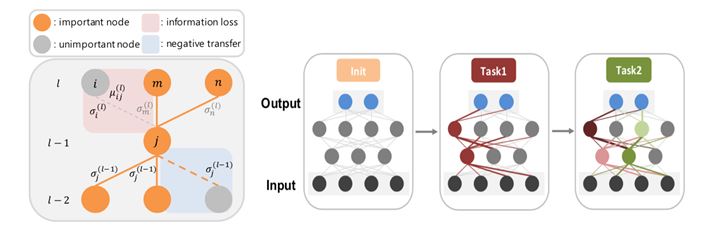

[논문 1, 그림 1] 제안하는 평생학습 알고리즘 (UCL)에서 고안한 노드 불확실성 (왼쪽)과 알고리즘 동작 예시 (오른쪽)

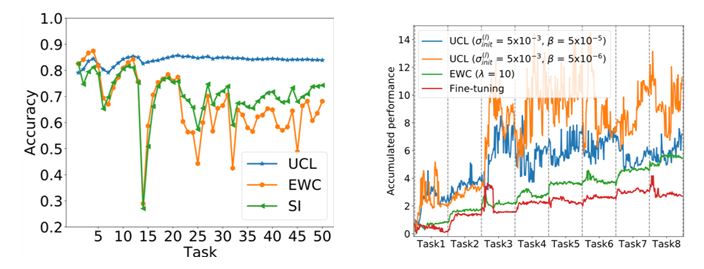

[논문 1, 그림 2] 지도학습 (왼쪽) 과 강화학습 (오른쪽)에서 공히 UCL 알고리즘이 기존 방법들 (EWC, SI, Fine-tuning 등)을 월등히 넘어서는 성능을 냄.

[논문 1, 그림 2] 지도학습 (왼쪽) 과 강화학습 (오른쪽)에서 공히 UCL 알고리즘이 기존 방법들 (EWC, SI, Fine-tuning 등)을 월등히 넘어서는 성능을 냄.

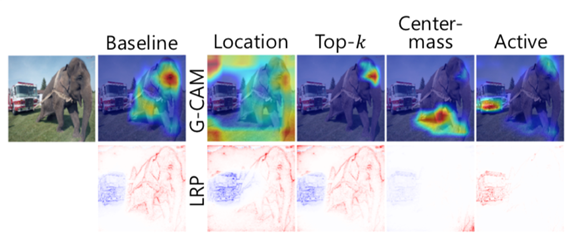

[논문 2, 그림 1] 제안하는 적대적 모델 조작에 의해 딥러닝 해석이 극적으로 바뀐 예시

[논문 2, 그림 1] 제안하는 적대적 모델 조작에 의해 딥러닝 해석이 극적으로 바뀐 예시

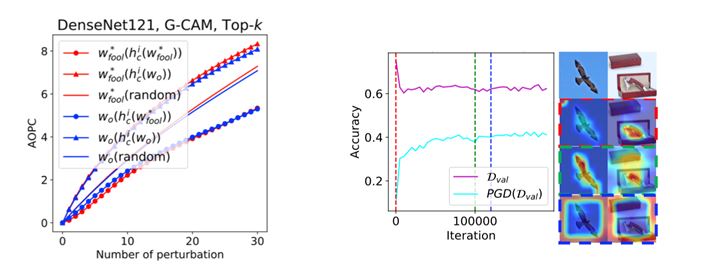

[논문 2, 그림 2] 제안하는 방법이 모델 자체가 아니라 해석 결과만 조작한 것이라는 데 대한 증거 결과 (왼쪽) 와 적대적 학습으로 얻은 모델도 조작 가능하다는 것을 보여주는 결과 (오른쪽)